Sanat suuhun

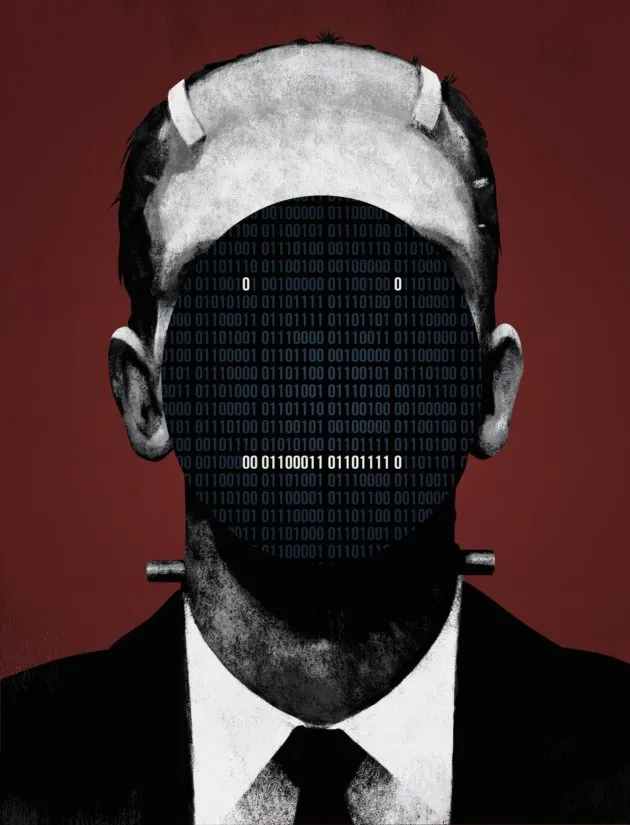

Kenet tahansa voi panna tekemään ja puhumaan videolla mitä tahansa. Voiko kohta uskoa enää mihinkään?

Viime huhtikuussa amerikkalainen uutissivusto Buzzfeed julkaisi videon, jolla entinen presidentti Barack Obama haukkuu presidentti Donald Trumpia ääliöksi. ”Total and complete dipshit.”

Kameraa suoraan katsova Obama ei kuulosta samalta mieheltä, joka Suomessa Nordic Business Forumissa heitteli hillittyjä piikkejä nimiä mainitsematta.

Ei hän olekaan sama, sillä video on tekaistu. Obama ei ollut sen teossa mukana. Video luotiin tekoälysovelluksella: Trumpia nimitteli näyttelijä, jonka puhe ja eleet siirtyivät videolla Obaman puheeksi ja eleiksi.

Viime vuoden loppupuolelta lähtien internetiin on ilmaantunut videoita, joissa tunnettujen näyttelijöiden kasvot on siirretty pornovideoon. Englannin kielellä videoita kutsutaan nimellä deepfake, suomeksi vaikkapa syvävale.

Kun yksityinen Reddit-sivuston käyttäjä tammikuussa julkaisi ohjelman nimeltä FakeApp, tekaistun julkkispornon määrä alkoi paisua. Tuli myös toisenlaisia kokeiluja, joissa poliitikkojen kasvoja siirrettiin uusiin asiayhteyksiin.

Vaikka FakeApp ei ole ainoa eikä ensimmäinen ohjelma kasvojen manipulointiin videolla, se on ensimmäinen riittävän helppo ja kaikkien saatavissa.

Se myös herätti haloon: jos kenestä tahansa voidaan tehdä videolla tahdoton sätkynukke, mihin enää voi tulevaisuudessa luottaa?

Kuvat vilisevät professori Jaakko Lehtisen tietokoneen ruudulla. Ne näyttävät eri-ikäisten ja erinäköisten ihmisten valokuvilta: on tummia, vaaleita, nuoria, vanhoja, vakavia, hymyileviä.

Erikoista kuvissa on se, että henkilöt eivät ole ketään eivätkä kuvat ole valokuvia. Kuvien ihmisiä ei ole olemassa, vaan tietokoneohjelma on ”hallusinoinut” kasvot, luonut ne.

Lehtinen on Suomen ensimmäinen tietokonegrafiikan professori ja hän työskentelee Otaniemessä Aalto-yliopistossa. Toinen työ on ohjelmistoyhtiö Nvidialla.

Koneellinen kasvojen luominen on yksi Nvidian projekti, joskaan sillä ei ole vielä tosielämän käyttöä.

Sekä olemattomien ihmisten että deepfake-valevideoiden luomisen ovat mahdollistaneet oppivat neuroverkot.

Kyse on tietokoneohjelmista, jotka eivät toimi annetuilla käskyillä vaan oppivat vähän niin kuin pikkulapset: isosta määrästä esimerkkejä.

”Koneet eivät tällä hetkellä ymmärrä meidän ihmisten maailmaa kauhean hyvin. Menetelmissä, joissa koneet pystyvät päättelemään kuvista asioita ja luomaan uutta kuvaa, motivaationa on oppia maailman luonteesta ja rakenteesta”, Lehtinen sanoo.

Jotta voisi ymmärtää jotain, pitää kyetä luomaan se. ”What I cannot create, I do not understand”, sanoi kuuluisa fyysikko Richard Feynman.

Kun oppivalle systeemille syöttää riittävän paljon ihmisen kuvia, se alkaa tajuta, mikä on ihminen ja mikä ei ole, mistä ihmisen tunnistaa, mitä ihmisessä voi olla ja mitä ei.

Elokuvateollisuudessa on luotu uskottavia illuusioita jo vuosikymmeniä, herätetty jopa kuolleita näyttelijöitä henkiin valkokankaalla.

Isolla rahalla, kovalla ammattitaidolla ja aikaa vievällä käsityöllä on saatu aikaan perinteistä tietokonegrafiikkaa, jota Jaakko Lehtinen kutsuu ”digitaaliseksi kuvanveistoksi”.

Tekoäly ei vielä pysty samaan, mutta se mahdollistaa jotain uutta. Ei tarvita digitaalista kuvanveistoa eikä kolmiulotteisia tietokonemalleja: vain kuvia, joilla neuroverkot opettavat itseään, päivien tai viikkojen ajan. Dataa rouskuttava neuroverkko hakeutuu perille logiikalla, jota kehittäjät eivät ennalta tiedä.

Annetaan koneelle vaikka 2 000 kuvaa Jussi Halla-ahosta ja 2 000 kuvaa Li Anderssonista, valokuvia tai videopätkästä eroteltua still-kuvaa.

Neuroverkot puristavat sekä Jussi Halla-ahon että Li Anderssonin kuvien informaation numeroiksi. Neuroverkko pystyy luomaan uuden kuvan tämän koneenkielisen kuvauksen pohjalta. Kun sitten Li Anderssonin kuvaus syötetäänkin toiselle neuroverkolle, joka osaa laatia kuvan Jussi Halla-ahosta, syntyy hybridi, jossa Andersson hyppää Halla-ahon nahkoihin.

Näyttelijä vääntelee naamaansa eri asentoihin, ja videolla Putin toistaa ilmeet sätkynukkena, reaaliaikaisesti.

Venäjän presidentti Vladimir Putin istuu pöydän ääressä ilman paitaa. Kaulassa on kultainen risti, hymy on mairea.

Hän toteaa englanniksi venäläisittäin murtaen: ”Hei Amerikka. Eilen teimme Donald Trumpista Yhdysvaltain 45:nnen presidentin. Hurraa, me teimme sen!”

Tämäkin FakeAppilla askarreltu pätkä löytyy Youtubesta.

Poliittiset johtajat ovat houkuttava valevideoiden kohde, ja myös helppo. Heistä löytyy tolkuttomasti valmista kuvamateriaalia neuroverkkojen pureskeltavaksi.

Toinen video Putinista on vielä häiritsevämpi. Näyttelijä vääntelee naamaansa eri asentoihin, ja videolla Putin toistaa ilmeet sätkynukkena, reaaliaikaisesti.

Jälkimmäinen teknologia on kansainvälisen tutkijaryhmän aikaansaannos. Mukana on muun muassa Stanfordin yliopiston ja saksalaisen Max-Planck-instituutin tutkijoita. Kun vielä toissa vuonna naamanvääntelijä-Putin näytti epäluonnolliselta, tänä vuonna tutkijat julkaisivat huikeasti parannettuja videoita.

Kulmakarvojen kohotus tai suun mutristus eivät pelkästään siirry kohdehenkilölle, vaan tekoäly sovittaa ne kohdehenkilön omaan ilmeiden kirjoon. Jopa henkilön varjot liikkuvat luonnollisesti.

Eikä tässäkään kaikki. Tekoälyn avulla voi tuottaa myös valeääntä. Buzzfeed toteutti Obaman puheen imitaationa, mutta tulevaisuuden trollitehtaiden ei tarvitse kyetä näyttelijäsuorituksiin.

Adobe esitteli vuonna 2016 äänen ”photoshoppaukseen” ohjelman, johon syötetään 20 minuuttia henkilön puhetta. Sen jälkeen ohjelma voi lukea käsikirjoitetun tekstin samalla äänellä.

Adoben ohjelmaa ei ole vieläkään myynnissä, mutta sitä odotellessa kanadalainen Lyrebird on julkaissut ohjelman, joka luo koneäänen vain yhden minuutin mittaisesta puhenäytteestä.

Kiinalainen teknologiajätti Baidu pani vielä paremmaksi: sen ohjelma luo koneäänen vain 3,7 sekunnin näytteestä.

Koneääntä voi hyödyntää vaikkapa käännöksissä ja dubbauksissa, mutta sillä on epäilemättä tilausta myös lähitulevaisuuden äänihuijauksissa. Jo nykyisin moni valeuutinen maailmalla leviää ääniviestinä Whatsappissa: viime kesänä esimerkiksi valeuutinen jalkapalloilijalegenda Diego Maradonan kuolemasta. Intiassa Whatsapp-huhuilla on jopa onnistuttu lietsomaan väkivaltaa.

”Emme ole kovin kaukana todellisuuden luhistumisesta.”

Näin kirjoitti journalisti, tietokirjailija Franklin Foer toukokuussa The Atlantic -lehden artikkelissaan.

Samanlaisia maailmanlopun ennustuksia on esitetty useita kertoja tämän vuoden aikana.

Professori Jaakko Lehtinen ei todellisuuden luhistumiseen usko.

Hänestä teknologian väärinkäytön mahdollisuus ei myöskään ole syy olla kehittämättä taustalla toimivaa tekoälyä. Konenäön ja havaitsemisen kehittämistä tarvitaan lukuisiin hyviin tarkoituksiin: vaikkapa itseajaviin autoihin tai avustajarobotteihin.

Lehtisellä itsellään on neurotieteilijöiden kanssa käynnissä projekti, jossa tutkitaan empatiaa ja hyödynnetään kasvojen vaihtoa liikkuvaan kuvaan. Miten katsoja reagoi, jos tunteikkaassa elokuvakohtauksessa esiintyykin katsoja itse, hänen puolisonsa, lapsensa tai äitinsä?

Lehtinen muistuttaa, että erilaisia valevideoita on tehtailtu jo kauan ennen deepfake-ohjelmia. Uskottava kasvojenvaihto on yhä melko työlästä. Buzzfeedin Obama-pätkä vaati 56 tuntia automaattista prosessointia ja lisäksi käsityötä Adobe After Effects -ohjelmalla. Tällä hetkellä useimmat feikit huvittavat enemmän kuin huijaavat.

”Samalla on sanottava, että kyllähän kehitys on sellaista, että medialukutaitoa tarvitaan lisää.

Yksittäisen videon luotettavuusarvo laskee varmasti”, Lehtinen sanoo.

Valevideoiden uhka ei ole vain siinä, että ne kehittyvät yhä paremmiksi. Uhka on siinä, että ne kelpaavat jo sellaisina kuin ne ovat.

Belgialainen sosialistipuolue laittoi viime keväänä levitykseen valevideon, jossa presidentti Donald Trump kehottaa Belgian kansaa vetäytymään ilmastosopimuksesta. Videossa mainitaan hyvin huomaamattomasti, että se on feikki, ja tekstityksessä sitä ei sanota lainkaan.

Trumpin suun liikkeet näyttävät epäaidoilta, imitaatio on sinnepäin. Mutta ei se mitään. Puolueen Facebook-seinä täyttyi kiivaista kommenteista, ja moni ei selvästi tajunnut, että video on tekaistu.

Ihmisten aivot hakemalla hakevat asioita, jotka sopivat omaan maailmankuvaan. Valeuutiset leviävät tutkitusti Twitterissä kuusi kertaa nopeammin kuin oikeat, olivat ne uskottavia tai eivät. Toteutuksen ei tarvitse olla hiottua, koska heikommatkin esitykset menevät läpi pelottavan hyvin.

On puhuttu totuudenjälkeisestä maailmasta, jossa faktoja kohdellaan enää mielipiteinä. Totta tai ei, ”näin nämä asiat koetaan”, kuten perussuomalaisten puoluesihteeri Riikka Slunga-Poutsalo totesi maahanmuuttokeskustelusta vuonna 2015.

Viime vuonna eräs norjalainen vitsinikkari julkaisi Facebookissa valokuvan tyhjistä bussinpenkeistä. Kuvakulma ja valaistus saivat penkit etäisesti näyttämään burkaan pukeutuneilta naisilta. Hyvin etäisesti. Suurin osa ihmisistä ei nähnyt kuin tyhjät penkit, mutta äärioikeistolaisten ryhmä täyttyi kauhistelevista kommenteista.

Vapaassa yhteiskunnassa, jossa joka tapahtumasta kertyy riippumatonta todistusaineistoa, valheilla on taipumus ennen pitkää paljastua. Ongelma on siinä, että vahinko on saattanut jo tapahtua ja oletetut syylliset lynkattu.

Samalla vallankäyttäjien on entistä helpompi kieltää mokansa, vaikka siitä löytyisi tallenne: en se ollut minä.

Muistia voi manipuloida. Valevideo, jolla epäilty tunnustaa rikoksen, voi saada jopa epäillyn itsensä uskomaan syyllisyyteensä.

Muisti on epäluotettava. Kun ihmisille on näytetty tekaistua uutiskuvaa ja kysytty, muistavatko he tapahtuman, huomattava joukko koehenkilöistä on varma siitä, että on nähnyt kuvan aiemmin tai vähintäänkin kuullut tapauksesta.

Valemuistojen tutkimuksen pioneeri, psykologi Elizabeth Loftus uskoo deepfake-videoiden voivan sekoittaa muistia entisestään. ”Kun ihmiset altistetaan niin voimakkaalle visuaaliselle esitykselle, miten he saavat sen pois mielestään?” Loftus kommentoi amerikkalaisella Vox-sivustolla heinäkuussa.

Loftus tietää mistä puhuu. Hän on tehnyt vuosikymmenten ajan uraauurtavaa tutkimusta valemuistojen istuttamisesta. Hän on saanut koehenkilöt muistamaan elävästi, kuinka he eksyivät pienenä kauppakeskukseen tai kuinka Disneylandia piinasi 90-luvulla Pluto-asuinen työntekijä, joka nuoleskeli pienten lasten korvia.

Ihmisen muisti ei toimi arkistohaun tavoin, vaan rakennamme muistot irrallisista informaationpalasista. Jos jälkeenpäin ilmenee uutta, nappaamme sen herkästi osaksi muistoa ja unohdamme, että muistoa on päivitetty. Kuvat painuvat mieleen, tietolähteet eivät.

Kehitämme olemattomia muistoja myös yhdessä. Kollektiivista väärinmuistamista kutsutaan ”Mandela-efektiksi”. Termi viittaa internetissä levinneeseen havaintoon, jonka mukaan moni muistaa Nelson Mandelan kuolleen vankilassa vuonna 1980, vaikka Mandela kuoli vasta vuonna 2013 ja ehti toimia 1990-luvulla Etelä-Afrikan presidenttinäkin.

Loftus pohti Vox-sivustolla, että videon todistusvoima on niin suuri, että väärinkäytösten vaara on ilmeinen.

Esimerkiksi valevideo, jolla epäilty tunnustaa rikoksen, voisi pahimmillaan saada jopa epäillyn itsensä uskomaan syyllisyyteensä.

”Emme voita tätä peliä. Teemme sen vain pahiksille vaikeammaksi ja vaikeammaksi.”

Näin tiivisti UC Berkeley -yliopiston professori Alexei Efros Scientific American -lehdessä syyskuussa. Efros tekee yhteistyötä Yhdysvaltain puolustusvoimien tutkimushankkeessa, joka etsii keinoja tunnistaa mediamaailman manipulaatioita.

Käynnissä on kilpajuoksu. Kun feikit kehittyvät, kehittyy niitä tunnistava teknologia.

Kiinalaiset tutkijat keksivät hiljattain yksinkertaisen tavan tunnistaa tyypilliset deepfake-videot: henkilöt eivät juuri räpyttele silmiään. Tämä johtuu siitä, että kuva-aineisto, joilla neuroverkkoja treenataan, ei usein sisällä kuvia, joissa henkilön silmät olisivat kiinni.

Tämä epäilemättä korjaantuu tulevaisuuden valevideoissa, jolloin pitää keksiä uutta.

”En ole täysin pessimisti. Mikään koneen tuottama ei ole täydellistä, ja samaan aikaan rikostekninen tutkimus kehittyy. Ei siinä aseettomia olla”, professori Jaakko Lehtinen sanoo.

Sama tutkijaryhmä, joka kehittää reaaliaikaista kasvonilmeiden muokkausta videolla, kouluttaa toista neuroverkkoa tunnistamaan valevideot. Neuroverkot sparraavat toisiaan kaksintaisteluna: toisen tehtävänä on luoda yhä uskottavampia valevideoita, toisen taas erottaa epäaidot aidoista.

Siihen nähden, kuinka pelottavana välineenä deepfake-videoista on puhuttu, on kuitenkin hieman yllättävää, ettei niitä ole vielä juurikaan valjastettu poliittisiin skandaaleihin.

Yksi FakeAppin keskeisistä käyttökohteista ovatkin tähän mennessä olleet Nicholas Cage -pätkät.

Raivokkaan suurieleisestä näyttelijäntyöstään tunnettu Cage on joutunut kestovitsin kohteeksi. Ideana on yksinkertaisesti laittaa hänen ilmeikäs naamansa mihin tahansa. Tekoälyn avulla Cagen kasvot on siirretty elokuviin, joissa hän ei oikeasti ole näytellyt.

Kun internet-kansa saa uuden lelun, mihin se sitä käyttää? Tietenkin meemeihin. Valeuutiset saattavat seurata perässä.